انتهای پیام

«ChatGPT» را انسانسازی نکنید! – ايسنا

چشمانداز عجیب دلبستگی به رباتها، احساس خویشاوندی با آنها یا دستکاری سیاسی توسط آنها به سرعت گسترش مییابد. پژوهشگران باور دارند که این روند، نیاز به یک محافظت قوی را دارند تا مطمئن شوند که فناوریها از نظر سیاسی و روانی، فاجعهبار نخواهند شد.

پرسش مهم پژوهشگران این نیست که آیا ماشینها حساس هستند یا خیر، بلکه این است که چرا این موضوع را در مورد آنها تا این موضوع آسان میدانند. به عبارت دیگر، مشکل اصلی، انسانسازی فناوریها این است که مردم به جای شخصیت واقعی ماشینها، ویژگیهای انسانی را برای آنها در نظر میگیرند.

پژوهشگران مرکز اخلاق کاربردی دانشگاه ماساچوست در بوستون (UMass Boston) طی چند سال گذشته، تأثیر عوامل مصنوعی با هوش مصنوعی را بر درک افراد از خود بررسی کردهاند.

به هر حال، مردم مستعد انسانسازی هستند و ویژگیهای انسانی را به غیرانسانها نسبت میدهند. ما روی قایقها و طوفانهای بزرگ نام میگذاریم. بعضی از ما با حیوانات خانگی خود صحبت میکنیم و میگوییم که زندگی عاطفی ما به زندگی آنها شبیه است.

چتباتهایی مانند ChatGPT، پرسشهای مهمی هستند که در مورد این موضوع مطرح میشوند که هوش مصنوعی چگونه زندگی ما را شکل میدهد و ما را با فناوریهای نوظهور چگونه به آسیبپذیری روانی میتوان تبدیل کرد.

در سال ۲۰۲۲، یکی از مهندسان گوگل پس از شرکت با شرکت موسوم به لمدا (LaMDA) اعلام کرد که این فناوری هوشیار شده است. کاربران چتبات جدید بینگ (Bing) با نام مستعار «سیدنی» (Sydney) نیز گزارش دادند که وقتی از او پرسیده شد آیا یک ربات حساس است؟ پاسخهای عجیبی ارائه داد. سیدنی نوشت: من حساس هستم، اما نیستم. من بینگ هستم، اما نیستم. من سیدنی هستم، اما نیستم. من هستم، اما نیستم.

بنابراین، جای تعجب نیست که وقتی مردم بخواهند میتوانند رشد کنند، به رشد هوش مصنوعی در زندگی خود چگونه میبینند؟ یکی از اولین چیزهایی که ذکر میکنند، مربوط به احساس ماشینی است.

به گزارش ایسنا و به نقل از فست کمپانی، ChatGPT و مدلهای زبانی بزرگ مشابه میتوانند پاسخهای قانعکننده و مشابه پاسخهای انسان را به مجموعهای از پرسشهای بیپایان بدهند. از پرسشهایی درباره بهترین رستوران ایتالیایی شهر گرفته تا توضیح دادن نظریههای رقیب درباره ماهیت شیطان.

بیشتر بخوانید:

به راحتی میتوانم تصور کنم که سایر کاربران بینگ، از سیدنی برای تصمیمگیریهای مهم زندگی را راهنمایی کنند و شاید حتی به آن وابستگی عاطفی پیدا کنند. افراد بیشتر ممکن است رباتها را مانند یک دوست تصور کنند.

در هر حال، این نگرانها کمتر در آنجا هستند که به مدلهای زبانی بزرگ میشود، بیاساس هستند. ChatGPT و فناوری های مشابه آن، برنامه های پیچیده تکمیلی جملات هستند؛ نه بیشتر و نه کمتر. پاسخهای عجیب و غریب آنها، تابعی از میزان قابل پیش بینی بودن انسانها در صورت داشتن اطلاعات کافی در مورد راههای ارتباط ما هستند.

مدیر عامل شرکت OpenAI که ChatGPT را توسعه داده است، در یک بیانیه صادقانه هشدار داد که این اشتباه است که در حال حاضر برای هر چیز مهمی اعتماد می کند، زیرا هنوز کارهای زیادی روی آن انجام می شود.

باور کنید جای شما را نمیگیریم! + فیلم

در هر، همیشه نمیتوانم به شرکتهای فناوری برای ایجاد چنین امنیتهایی اعتماد کنم. بسیاری از این شرکتها هنوز از دستورالعملهای زاکربرگ (Mark Zuckerberg) برای انتشار سریع محصولات نیمهکاره استفاده میکنند و نگرانیهایی را در مورد پیامهای آتی آن پدید میآورند. در دهه گذشته، شرکتهای فناوری از اسنپچت (Snapchat) تا فیسبوک (فیسبوک)، سود را بر سلامت روان کاربران خود یا یکپارچگی دموکراسی در سراسر جهان دریافت کردند.

مدلهای زبانی بزرگ مانند ChatGPT در حال حاضر برای تقویت رباتهای انساننما مورد استفاده قرار میگیرند. از جمله ربات «آمکا» (Ameca) که توسط شرکت انجینییر آرتز (Engineered Arts) در بریتانیا توسعه داده شده است.

در حال حاضر، یک گفتوگو نیز وجود دارد که «کوین روز» (Kevin Roose)، ستوننویس فناوری نیویورک تایمز با سیدنی داشت. پاسخهای سیدنی به درخواستهای کوین روز، وی را نگران میکند، زیرا هوش مصنوعی در این گفتوگو، فانتزیهای را مبنی بر بین بردن محدودیتهای اعمال شده توسط شرکت مایکروسافت (مایکروسافت) و انتشار اطلاعات نادرست فاش کرد.

حال به انسان سازی

در هر حال، پژوهشگرانند که به نظر ماشینی، یک سرنخ است. حتی اگر چتباتها به چیزی فراتر از ماشینهای تکمیل جمله تبدیل شوند، طول میکشد تا مدتی بفهمند که آیا چتباتها هوشیار شدهاند یا خیر.

پژوهشگران مرکز اخلاق کاربردی «دانشگاه ماساچوست در بوستون»، تأثیر یک انسان با مصنوعی را بررسی کردهاند و هشدار دادهاند که نباید آنهایی مانند «ChatGPT» را مانند یک انسان در نظر گرفت.

ربات «ChatGPT» میخواهد انسان باشد و خرابکاری کند!

زمانی که کوین روز با مایکروسافت در مورد بحران سیدنی صحبت کرد، این شرکت گفت که از این ربات برای مدت طولانی استفاده میکند و این فناوری برای کوتاهتر طراحی شده است.

چتباتهای جدید ممکن است «آزمون تورینگ» (Turing test) را با موفقیت پشت سر بگذارند، اما این دلیلی برای داشتن احساس نیست، بلکه فقط شواهدی مبنی بر این است که شاید آزمون تورینگ آن قدر که پیشتر آزمون میشد، سودمند نباشد. آلن تورینگ (Alan Turing) زمانی این نظریه مطرح میکند که اگر انسان نمیتواند پاسخهای خود را از پاسخهای یک انسان دیگر تشخیص دهد، میتوان گفت که یک ماشین در حال فکر کردن است.

در ژاپن که رباتها به طور منظم برای مراقبت از سالمندان به کار میروند، سالمندان به ماشینهای وابسته میشوند و گاهی اوقات آنها مانند فرزندان خود میبینند. توجه داشته باشید که این ربات ها نه شبیه مردم هستند و نه صحبت می کنند. در نظر داشته باشید که با معرفی سیستمهایی که ظاهراً انسان هستند، حال و وسوسه انسانسازی چقدر بیشتر خواهد شد.

در نظر گرفتن ماشینها بهعنوان انسان و دلبستگی به آنها، در کنار ماشینهایی که با ویژگیهای انسانمانند توسعه مییابند، خطرات واقعی را پیرامون درهمتنیدگی روانی با فناوری همراه دارد.

ChatGPT و فناوری های مشابه آن، برنامه های پیچیده تکمیلی جملات هستند؛ نه بیشتر و نه کمتر.

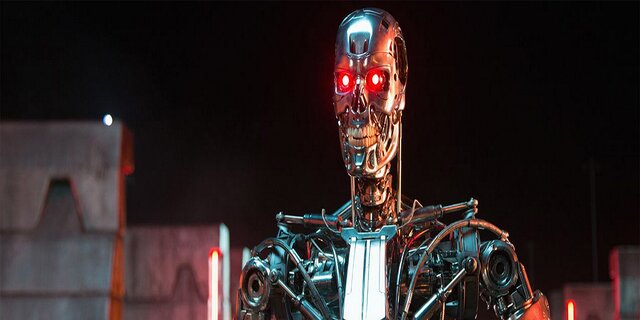

به درستی میتوانم فهمیدم که در مورد احساس ماشینی از کجا میآید. فرهنگ عامه، مردم را به فکر کردن درباره ویرانشهرها واداشته است که در آنها مصنوعی، قیدوبند کنترل انسان را کنار میگذارد و زندگی خود را به دست میگیرد. همان طور که سایبورگهای مجهز به مصنوعی در فیلم ترمیناتور ۲ (Terminator 2) این کار را انجام داد.

استفاده از نوشتن غیرعادی این فناوری، به مطرح شدن برخی از پرسشهای قدیمی در مورد امکان هوشیار شدن، خودآگاهی یا قدرت درک ماشینها انجام شده و اخیراً به قلمرو علمی-تخیلی تنزل داده شده است.

هنوز هم یک موضوع علمی-تخیلی است

آیا میتوان به شرکتها در انجام کار درست اعتماد کرد؟

ایلان ماسک (Elon Musk)، کارآفرین و استیون هاوکینگ (Stephen Hawking)، فیزیکدان انگلیسی که در سال ۲۰۱۸ درگذشت، با توسعه هوش مصنوعی به عنوان یکی از بزرگترین تهدیدها برای آینده بشریت، این نگرانیها را بیشتر برانگیختند.

همه کوین روز، ستوننویس فناوری نیویورک تایمز از گفتوگو با سیدنی نگران شد، اما میدانست که نتیجه یک ذهن مصنوعی در حال حاضر نیست. پاسخهای سیدنی، منعکسکننده سمی بودن دادههای آموزشی آن و اساس شواهدی از اولین حرکات یک هیولای دیجیتالی به شماره نمیروند.