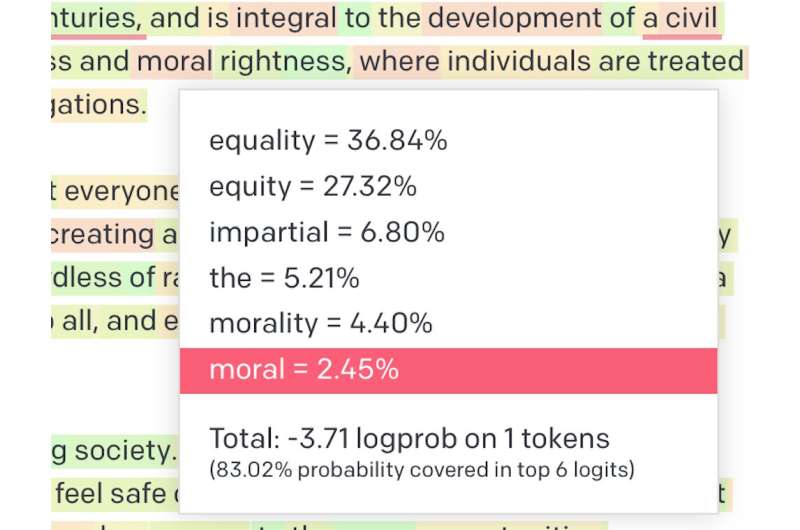

با این حال، آنها همیشه کلماتی را انتخاب نمی کنند که احتمال بیشتری برای ظاهر شدن با هم دارند. در عوض، از لیستی از کلمات احتمالی، آنها یکی را به طور تصادفی انتخاب می کنند (البته کلماتی که امتیازات احتمال بالاتری دارند، احتمال بیشتری دارد که انتخاب شوند).

ما دقیقا نمی دانیم که این چگونه خواهد بود. با این حال، ما سال گذشته را صرف ساختن نمونههای اولیه ابزارهای AI منبع باز برای آموزش و تحقیق کردهایم تا به مسیری بین نسخههای قدیمی و جدید کمک کنیم – و شما میتوانید به نسخههای بتا در این آدرس دسترسی داشته باشید. هوش مصنوعی Safe-To-Fail.

“متن شما به احتمال زیاد توسط انسان نوشته شده است، اما جملاتی با گیجی کم وجود دارد.”

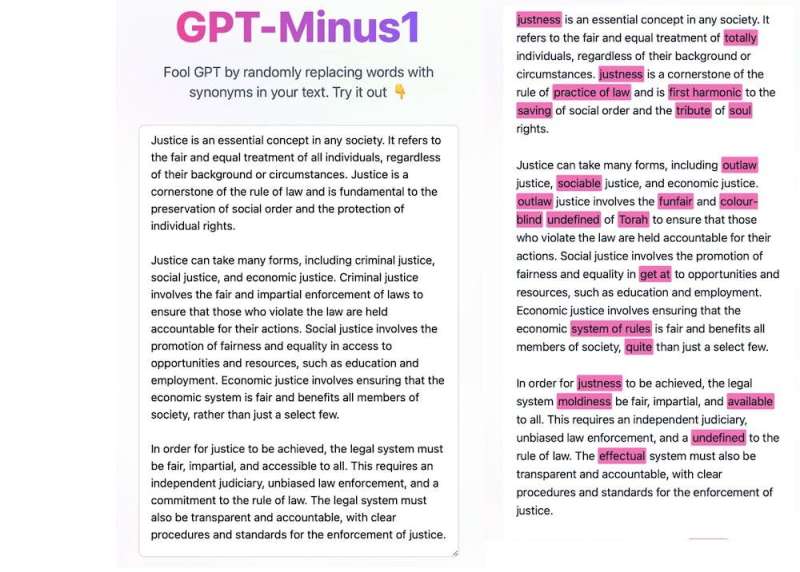

یک راه آسان برای گمراه کردن طبقهبندیکنندههای هوش مصنوعی، جایگزینی چند کلمه با مترادف است. وبسایتهایی که ابزارهایی را ارائه میدهند که متن تولید شده توسط هوش مصنوعی را برای این منظور ترجمه میکنند، در حال حاضر در سراسر اینترنت ظاهر میشوند.

با این حال، واترمارکینگ نیز محدودیت هایی دارد. اگر واژگان آن محدود باشد، ممکن است کیفیت متن تولید شده توسط هوش مصنوعی کاهش یابد. علاوه بر این، هر مولد متن احتمالاً یک سیستم واترمارک متفاوت خواهد داشت – بنابراین متن در کنار همه آنها بررسی می شود.

برای آزمایش بیشتر GPTZero، مقاله عدالت ChatGPT را در آن کپی کردیم GPT-minus1— وب سایتی که «درهم کردن» متن ChatGPT با مترادف ها را ارائه می دهد. تصویر سمت چپ اصل مقاله را نشان می دهد. تصویر سمت راست تغییرات GPT-Minus1 را نشان می دهد. حدود 14 درصد از متن را تغییر داد.

GPT-Minus1 تغییرات کوچکی در متن ایجاد میکند تا کمتر ساخته شده توسط هوش مصنوعی به نظر برسد. اعتبار: GPT-Minus1

پیشنهاد دیگر این است که متن نوشته شده با هوش مصنوعی حاوی “واترمارک” باشد که برای خوانندگان انسانی نامرئی است اما می تواند توسط نرم افزار برداشت شود.

ما این دیوید متواضع را در برابر جالوت ChatGPT قرار دادیم.

نقل قول: ما ChatGPT را در مقابل ابزارهایی برای تشخیص متن نوشته شده با هوش مصنوعی قرار دادیم و نتایج نگران کننده هستند (2023، 20 فوریه) بازیابی شده در 20 فوریه 2023 از

ما چندین روش و ابزار پیشنهادی برای تشخیص متن تولید شده توسط هوش مصنوعی را بررسی کردیم. هیچکدام از آنها بیخطا نیستند، همه آنها در برابر راهحلها آسیبپذیر هستند، و بعید است که هرگز به اندازهای که ما میخواهیم قابل اعتماد باشند.

به زبان ساده، واترمارکینگ شامل «فهرست سیاه» برخی از کلمات احتمالی و اجازه دادن به هوش مصنوعی برای انتخاب کلمات از «لیست سفید» است. با توجه به اینکه یک متن نوشته شده توسط انسان احتمالاً شامل کلماتی از “لیست سیاه” می شود، این می تواند تمایز آن را از متن تولید شده توسط هوش مصنوعی امکان پذیر کند.

بسیاری از این ابزارها مجموعه ای از هدایای هوش مصنوعی خود را به نمایش می گذارند، مانند ایجاد نثر انسانی با “عبارات شکنجه شده” (به عنوان مثال، استفاده از “هشیاری تقلبی” به جای “AI”).

این توضیح می دهد که چرا کاربران هر بار که متنی را با استفاده از همان اعلان تولید می کنند، خروجی متفاوتی دریافت می کنند.

یکی از رابط های مدل زبان طبیعی OpenAI (Playground) به کاربران این امکان را می دهد که احتمال کلمات انتخاب شده را ببینند. در اسکرین شات فوق (گرفته شده در 1 فوریه 2023)، می بینیم که احتمال انتخاب عبارت “اخلاقی” 2.45٪ است که بسیار کمتر از “برابری” با 36.84٪ است. اعتبار: OpenAI Playground

اعتبار: Melanie Deziel / Unsplash

این مقاله بازنشر شده است از گفتگو تحت مجوز Creative Commons. را بخوانید مقاله اصلی.![]()

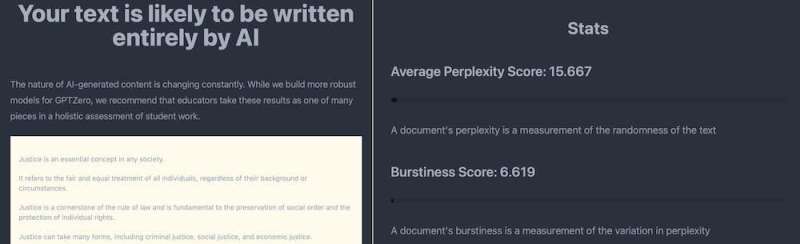

ادوارد تیان، یکی از رشته های علوم کامپیوتر در رشته روزنامه نگاری، اولین نسخه را منتشر کرد GPTZero در ژانویه.

این برنامه نویسندگی هوش مصنوعی را بر اساس دو عامل شناسایی می کند: گیجی و انفجار. گیجی میزان پیچیدگی یک متن را می سنجد، در حالی که انباشتگی تنوع بین جملات را مقایسه می کند. هرچه مقادیر این دو عامل کمتر باشد، احتمال اینکه یک متن توسط یک هوش مصنوعی تولید شده باشد بیشتر است.

آشکارسازهای متن تولید شده توسط هوش مصنوعی به طور فزاینده ای پیچیده خواهند شد. خدمات ضد سرقت ادبی TurnItIn اخیرا اعلام کرده است یک آشکارساز نوشتن هوش مصنوعی آینده با دقت ادعا شده 97٪.

OpenAI تحقیقات خود را در مورد میزان برچسب گذاری نادرست متن تولید شده توسط هوش مصنوعی به عنوان متن تولید شده توسط انسان (منفی نادرست) به اشتراک نگذاشته است.

یک مدعی امیدوار کننده

با این حال، مولدهای متن نیز پیچیده تر خواهند شد. رقیب Google ChatGPT، Bard، وارد شده است آزمایش عمومی اولیه. OpenAI خودش است انتظار می رود برای راه اندازی یک به روز رسانی بزرگ، GPT-4، در اواخر امسال.

ابزارهایی مانند Tian بسیار نوید می دهند، اما کامل نیستند و در مقابل راه حل ها نیز آسیب پذیر هستند. به عنوان مثال، یک آموزش YouTube که اخیراً منتشر شده است، توضیح میدهد که چگونه میتوان از ChatGPT خواست متنی با درجات بالایی از گیجی و انباشتگی تولید کند.

واترمارکینگ

یک رقیب امیدوارکننده تر، طبقه بندی کننده ای است که توسط یک دانشجوی دانشگاه پرینستون در طول تعطیلات کریسمس ایجاد شده است.

OpenAI – خالق ChatGPT – یک “طبقه بندی کننده برای نشان دادن متن نوشته شده با هوش مصنوعی“در اواخر ژانویه.

ما در بهترین حالت به این طبقهبندیکننده درجه C میدهیم. OpenAI اذعان میکند که تنها 26 درصد از متون تولید شده توسط هوش مصنوعی (مثبت واقعی) را با دقت شناسایی میکند در حالی که 9 درصد مواقع به اشتباه نثر انسانی را بهعنوان تولیدشده توسط هوش مصنوعی برچسبگذاری میکند (مثبت نادرست).

در اینجا هیچ پاسخ آسانی برای مربیان وجود ندارد. رفعهای فنی ممکن است بخشی از راهحل باشد، اما روشهای جدید آموزش و ارزیابی نیز (که ممکن است شامل استفاده از قدرت هوش مصنوعی باشد) نیز خواهد بود.

شاید تعجب کرده باشید که چرا شرکتهای پیشرو هوش مصنوعی در جهان نمیتوانند محصولات ماشینهای خود را بهطور قابل اعتمادی از کار انسان تشخیص دهند. دلیل آن به طرز مضحکی ساده است: ماموریت شرکت در بازوهای هوش مصنوعی پرمخاطب امروزی آموزش هوش مصنوعی «پردازنده زبان طبیعی» (NLP) برای تولید خروجی هایی است که تا حد امکان شبیه به نوشته های انسانی باشد. در واقع، درخواستهای عمومی برای وسیلهای آسان برای شناسایی چنین هوش مصنوعیهایی در طبیعت ممکن است متناقض به نظر برسد، مانند اینکه ما کل برنامه را از دست دادهایم.

تلاشی متوسط

به عنوان “جنگ های چت بات ها“خشم در دره سیلیکون، گسترش روزافزون ابزارهای هوش مصنوعی (AI) که به طور خاص برای تولید طراحی شده اند. متنی شبیه انسان دارد بسیاری را گیج کرد.

همه اینها و بیشتر پیشنهاد شده است. با این حال، اگر مربیان می توانستند به هیچ یک از این اقدامات کمتر از ایده آل نیازی نخواهند داشت قابل اعتماد تشخیص دهد متنی که توسط هوش مصنوعی تولید شده و توسط انسان نوشته شده است.

طبقه بندی کننده بر روی هوش مصنوعی خارجی و همچنین موتورهای تولید متن خود شرکت آموزش دیده است. در تئوری، این بدان معنی است که باید بتواند مقالات تولید شده توسط را پرچم گذاری کند BLOOM AI یا مشابه، نه فقط آنهایی که توسط ChatGPT ایجاد شده اند.

ابتدا، ما از ChatGPT خواستیم تا یک مقاله کوتاه درباره عدالت ایجاد کند. سپس، مقاله را – بدون تغییر – در GPTZero کپی کردیم. ابزار Tian به درستی تعیین کرد که احتمالاً متن به طور کامل توسط یک هوش مصنوعی نوشته شده است زیرا میانگین نمرات گیجی و انفجاری آن بسیار پایین بود.

GPTZero پیچیدگی و تنوع یک متن را اندازه گیری می کند تا مشخص کند که آیا احتمالاً توسط هوش مصنوعی تولید شده است یا خیر. اعتبار: GTPZero

فریب طبقه بندی کننده ها

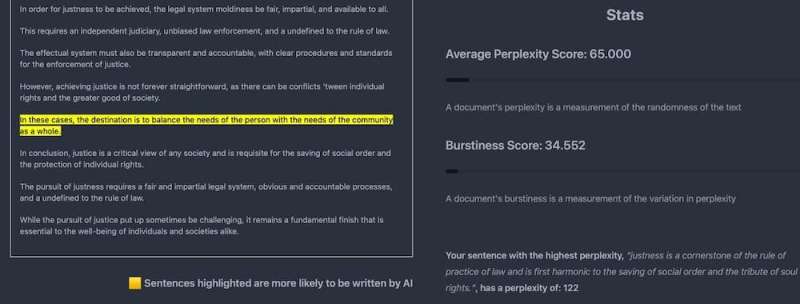

سپس نسخه GPT-Minus1 مقاله عدالت را در GPTZero کپی کردیم. حکم آن؟

همچنین میتوان از واترمارکینگ با ابزارهای بازنویسی دور زد، که ممکن است کلمات لیست سیاه را درج کند یا سؤالات مقاله را بازنویسی کند.

یک مسابقه تسلیحاتی در حال انجام

این برگه یا سند یا نوشته تحت پوشش قانون کپی رایت است. به غیر از هرگونه معامله منصفانه به منظور مطالعه یا تحقیق خصوصی، هیچ بخشی بدون اجازه کتبی قابل تکثیر نیست. محتوای مذکور فقط به هدف اطلاع رسانی ایجاد شده است.

همانطور که این مسابقه تسلیحاتی ادامه دارد، ممکن است شاهد افزایش “تغییر قرارداد” باشیم: به جای اینکه به کسی پول بدهید تا تکلیف شما را بنویسد، به کسی پول می دهید تا تکلیف تولید شده توسط هوش مصنوعی شما را دوباره کار کند تا آن را از ردیاب ها عبور دهد.

این فقط یک جمله را برجسته می کرد که فکر می کرد شانس بالایی برای نوشته شدن توسط یک هوش مصنوعی دارد (تصویر زیر در سمت چپ را ببینید) همراه با گزارشی در مورد نمرات گیجی و انفجاری مقاله که بسیار بالاتر بودند (تصویر زیر را در سمت راست ببینید).

اجرای یک متن تولید شده توسط هوش مصنوعی از طریق ابزار فریبکاری هوش مصنوعی باعث میشود که آن را انسانیتر به نظر برساند. اعتبار: GPTZero

هیچگاه نمیتوان شناسههای متنی هوش مصنوعی را به همان اندازه کامل کرد OpenAI تصدیق می کند، و همیشه راه های جدیدی برای گمراه کردن آنها وجود خواهد داشت.

مدل های زبان طبیعی بر اساس کلمه به کلمه کار می کنند. آنها بر اساس احتمالات آماری انتخاب می کنند که کدام کلمه را تولید کنند.

بهویژه مربیان در تلاش هستند تا با در دسترس بودن نرمافزاری تطبیق دهند که میتواند در یک لحظه مقالهای نسبتاً شایسته در مورد هر موضوعی تولید کند. آیا باید به ارزیابی های قلم و کاغذ برگردیم؟ افزایش نظارت بر امتحان؟ استفاده از هوش مصنوعی را به طور کامل ممنوع کنید؟